作者:SmartX 金融团队 徐鑫

随着容器技术(特别是 Kubernetes)的广泛应用,越来越多的企业开始关注如何通过容器提升应用的灵活性、扩展性和运维效率。在此背景下,许多行业用户对超融合技术的适用性产生了疑问:

- “超融合架构适合虚拟化的应用场景,但是否能满足容器化场景的需求?”

- “基于超融合的基础设施能够支持容器编排、调度、负载均衡等功能吗?”

- “超融合架构是否能为容器化应用提供足够的网络和存储资源保障?”

- “超融合是否能与 Kubernetes 等容器平台无缝融合,实现容器环境的高效运行?”

在很长一段时间里,行业对“超融合承载容器”的能力存在诸多质疑,认为其更适合虚拟机场景,无法应对云原生应用的灵活性与复杂性。然而,随着 SMTX Kubernetes 服务(SKS)在多家大型企业落地,这一认知正在逐步改变——SKS 构建在榫卯企业云平台之上,深度融合虚拟化、存储、网络与安全能力,面向多租户、多形态、混合架构的容器化需求,帮助企业构建统一、高效、可控的容器基础设施平台。同时,榫卯企业云平台通过模块化的产品架构和平台原生的容器服务,为容器场景提供全生命周期的支撑能力,彻底打破了“虚拟机 vs 容器”的二元对立,让企业在一个统一架构中同时管理虚拟化与云原生负载。

以下,我们将以 SKS 为例,针对上述超融合“误区”进行“辟谣”!

厘清误区

看法一:虚拟化天然不适合容器,容器只能跑在裸金属上

| ❌ 误区成因 |

| 在不少工程团队看来,Kubernetes 天生适合部署在裸金属上,因为省去了虚拟化层,理论上能获得更高的性能、更少的资源浪费,放在虚拟化上反而是“画蛇添足”。 然而,虚拟化和容器之间并非是“此消彼长”的关系。对多数企业而言: -容器集群往往要与现有虚拟化环境集成,复用已有资源; -基于虚拟机的部署方式,可以更容易实现资源隔离、多租户安全、集群生命周期管理等需求; -构建多个测试/预发布/生产环境的 Kubernetes 集群时,虚拟化能够提供更好的灵活性和稳定性。 特别是存在多集群、多环境、多业务并发场景的企业,虚拟化与容器的协同反而是架构现代化的“标配模式”。 |

| ✅ 基于 SmartX 企业云的真实情况 |

| 企业用户之所以倾向于裸金属部署容器,主要源于对性能和资源利用效率的担忧。然而,在实际企业环境中,虚拟化能带来显著的管理与安全优势: -虚拟化为容器节点提供了更好的资源隔离,避免裸金属环境中可能存在的资源抢占和冲突问题。同时,通过虚拟化的高可用(HA)机制与动态资源调度能力,能够实现 Kubernetes 集群节点的快速自愈与自动恢复,显著降低业务中断风险。 -虚拟化允许企业快速搭建多个测试、开发、预生产和生产环境的 Kubernetes 集群,实现快速扩展,确保业务连续性和环境隔离。 -在极致性能需求场景下,SKS 同样提供了物理机节点的混合部署模式,企业可将部分性能敏感型业务部署在裸金属节点上,而将更多日常运维和普通业务部署在虚拟机节点上,平衡了极致性能和高效管理的需求。 |

看法二:超融合搭建 Kubernetes 集群过程繁琐,效率低下

| ❌ 误区成因 |

| 一些技术人员认为,Kubernetes 本身就是开源的,装在哪都能跑,在裸金属或公有云上搭建集群也很成熟,没必要为了部署容器再引入超融合。而另一方面,也有不少人质疑:“超融合平台又不是做容器的,部署 Kubernetes 还要靠手工,一搞就是几个小时,效率太低。” 这种认知忽略了一个关键点:集群上线速度本身也是基础架构产品力的一部分。在现代 IT 环境中,集群交付速度、自动化能力、配置一致性,直接影响开发节奏和资源响应效率。如果一个平台不能做到快速、可复制、自动化地交付 Kubernetes 集群,就难以支撑企业级多环境、多租户的容器实践。 此外,用户也经常担心 Kubernetes 调度会与虚拟化平台脱节,Pod 无法感知底层虚拟机与宿主机资源状态,导致调度割裂的问题。尤其在多租户或多集群环境下,容易出现 Pod 分布不均、关键服务集中、虚拟机负载失衡等问题,影响系统的高可用性与安全性。 |

| ✅ 基于 SmartX 企业云的真实情况 |

| 基于 SmartX 原生虚拟化 ELF 平台,SKS 提供自动化、标准化的 Kubernetes 集群全生命周期管理功能。用户只需通过直观的图形界面简单操作,即可在几分钟内完成 Kubernetes 集群的创建过程,极大缩短部署时间,提高团队的工作效率。 SKS 支持 Kubernetes 集群的自动扩缩容、故障节点自动检测与替换、版本升级和回滚等功能,显著降低运维负担和人工干预。企业用户在日常运维中能够快速响应业务变化需求,及时进行资源动态调配与扩展。 企业可以在统一的平台内同时管理多个不同用途、版本与规模的 Kubernetes 集群,这些集群之间实现了资源与网络的逻辑隔离,互不干扰。通过超融合集群的虚拟化技术,能够有效共享底层硬件资源并及时回收闲置资源,大幅提高资源利用效率并降低总体拥有成本。而关于“Pod-虚拟机-宿主机”的三层调度一致性,在 SKS 中通过以下方式得到了有效保障: –Worknode (VM) – Host 调度:平台自动为控制节点和工作节点虚拟机设置反亲和性策略,确保分布在不同宿主机上,降低物理层面故障影响。 –Pod – Worknode (VM) 调度:用户可结合标签和业务需求设置 Kubernetes 亲和/反亲和策略,引导关键 Pod 合理分布在各 VM 上,避免资源倾斜。 –自动恢复:SKS 基于 Cluster API 支持节点故障自动替换,新节点继承原调度策略,保持调度与资源布局一致性。 这套机制无需用户介入底层宿主机,也不必自建调度逻辑,就能确保容器从 Pod 到宿主机的完整调度链条,真正实现稳定、安全的生产级部署。 |

看法三:超融合容器平台性能是否能够满足实际业务需求?

| ❌ 误区成因 |

| “容器是为性能敏感场景而生的,用超融合部署 Kubernetes 会不会拖慢业务?”这是另一个常见的顾虑。尤其是在运行数据库、Kafka、Spark 这类重型容器化应用时,企业更倾向于以“裸金属+本地盘”来最大化性能输出。 但现实情况中,多数业务并非都处于极限负载场景,企业普遍需要的是性能+稳定性+可维护性的综合平衡。 |

| ✅ 基于 SmartX 企业云的真实情况 |

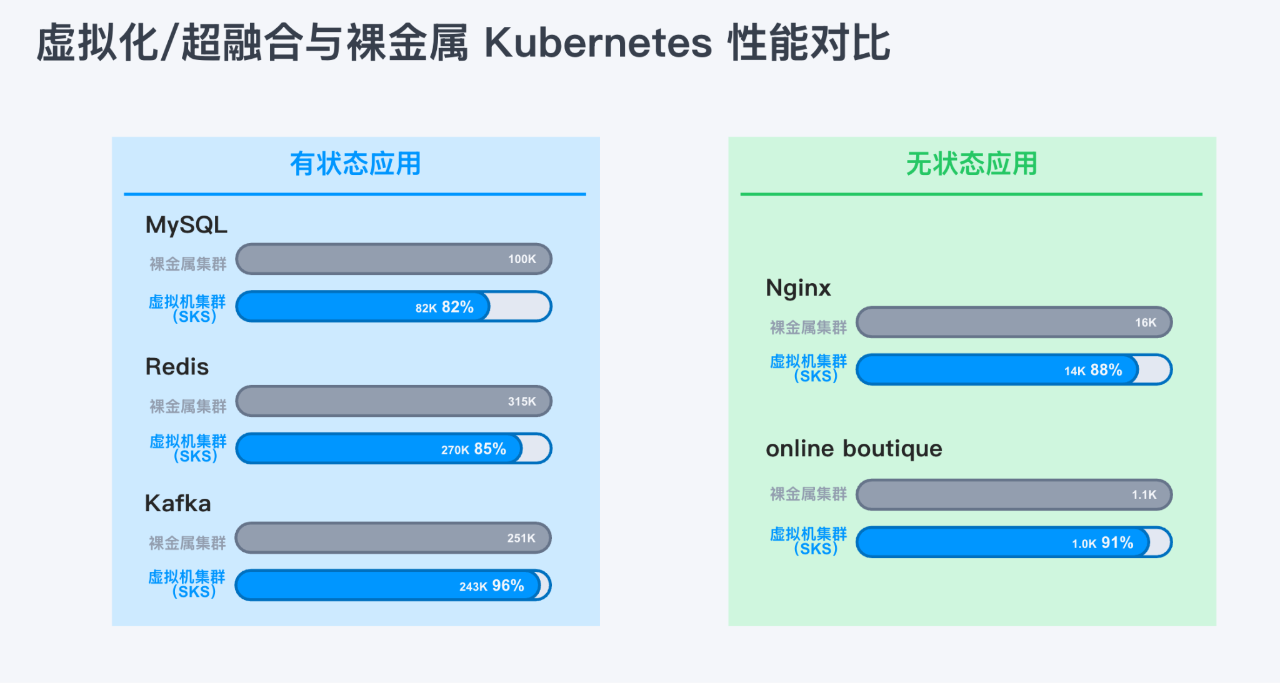

| SKS 提供混合部署模式,允许企业同时使用虚拟机和物理机节点,充分满足不同应用场景的差异化性能需求。在极致性能要求的业务场景中,企业可以选择物理机节点,以避免虚拟化性能损耗,追求最大计算性能。此外,企业也可以充分利用现有旧服务器资源,以物理机形式加入 SKS 集群,优化资源投入和成本管理。SKS 也支持统一平台下物理机和虚拟机 Kubernetes 集群的集中管理,企业可在单一界面完成多种计算资源类型的统一调度与管理。 另外,实际的性能测试结果显示,SKS 虚拟化集群在主流有状态和无状态应用场景中,其性能表现均能达到裸金属 Kubernetes 集群性能的较高比例。例如在有状态应用中,MySQL 性能达到裸金属的 82%、Redis 达到 85%、Kafka 更是高达 96%;无状态应用如 Nginx 达到裸金属的 88%,online boutique 应用达到 91%。 这一测试结果表明,超融合虚拟化的性能损耗已经极小化,足以覆盖绝大多数在线业务的实际需求。而以上性能差距,在享受到更高的资源利用率、故障隔离能力、部署效率之后,反而成为可接受甚至更值得的“成本”。 |

看法四:超融合存储无法满足容器场景的高性能需求

| ❌ 误区成因 |

| 有状态容器的使用场景越来越多,如数据库、Kafka、日志服务等,这对存储的性能、可靠性提出了很高要求。不少用户担心:“超融合的存储系统偏向通用,性能不如专业 SAN,难以支撑状态型容器”。 这一观点在早期或许有一定代表性,但近年来超融合平台的自研分布式存储系统已经能够提供高 IOPS、低延迟的持久存储能力,同时支持容器存储接口(CSI)、动态卷管理、数据冗余和快照回滚等能力,满足生产级容器的使用需求。 |

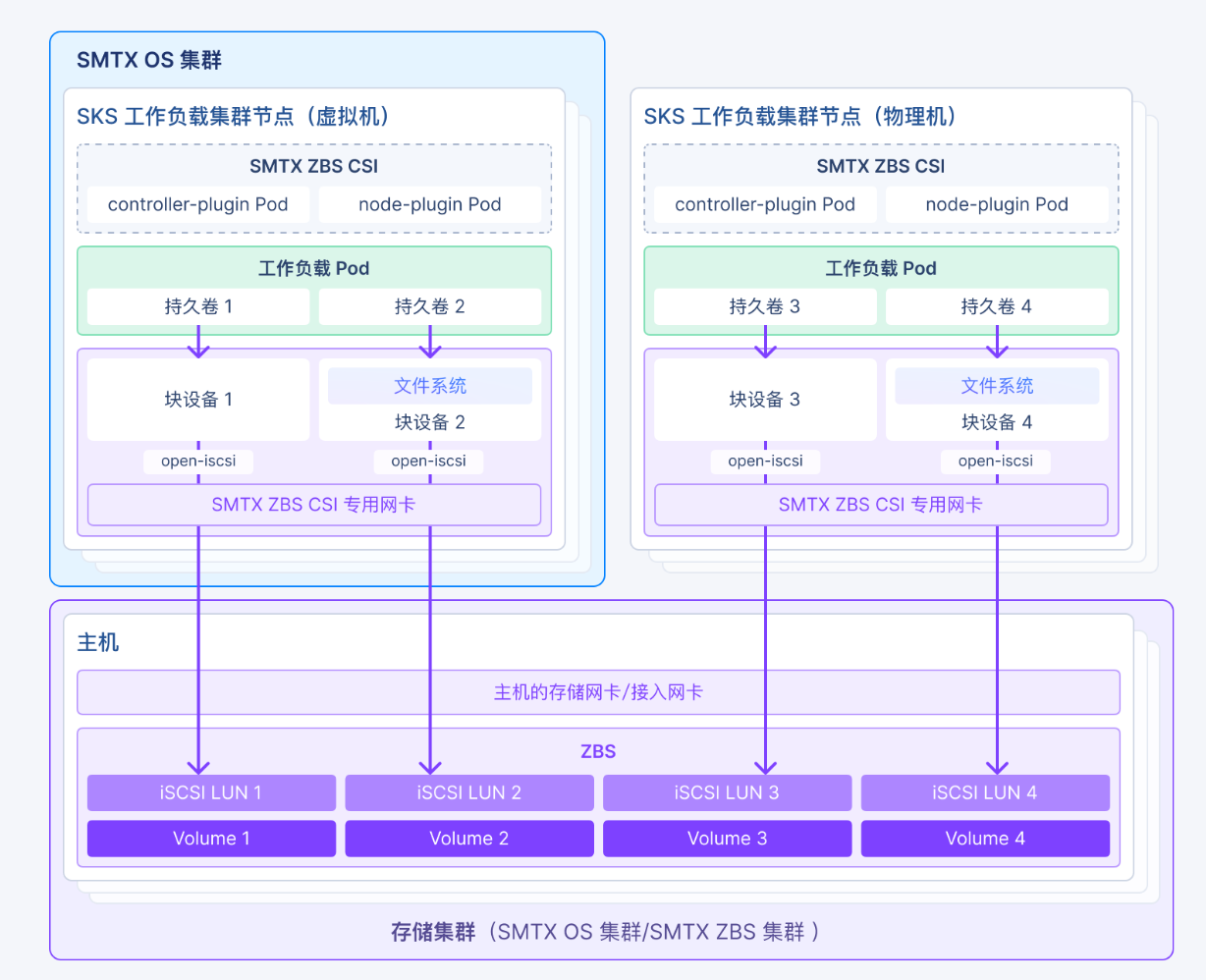

| ✅ 基于 SmartX 企业云的真实情况 |

| SKS 基于榫卯企业云平台提供的高性能分布式存储,可提供成熟、高效且易维护的存储解决方案。 –高可靠:数据通过多副本机制分布在多个物理节点上,从根本上避免了单点故障的风险。即使单个节点发生故障,数据仍然可以从其他节点获取,保障了数据的高可用性。 –高性能:通过存储系统的自适应恢复、智能容量平衡以及数据的 I/O 本地化技术,SKS 可以为数据库、缓存服务和日志系统等提供稳定且卓越的存储性能,满足企业级关键应用的高负载场景。 –易运维:榫卯企业云平台通过 Kubernetes 原生的 CSI 插件提供存储服务,无需复杂的存储配置过程,只需通过简单的 Kubernetes PV/PVC 配置即可获得生产级存储资源。同时,这些虚拟卷可以直接用作 Kubernetes 节点的系统盘、etcd 数据库存储、日志数据存储以及有状态应用的持久化存储,极大简化了日常的运维管理任务。SKS 也提供直观易用的图形化界面,允许管理员便捷地进行存储配置、监控和维护。 |

看法五:超融合网络难以满足容器复杂的网络与安全需求

| ❌ 误区成因 |

| Kubernetes 的网络模型强调 Pod 扁平通信、服务发现、东西向流量隔离、南北向访问控制等能力,但很多企业在实践中发现:虚拟机和容器常常跑在两个网络体系里,无法直接互通,需要搭桥或额外部署网关,延迟高、路径绕,安全策略还需要单独维护。 因此有人认为:“超融合平台本身只是跑虚拟机的,容器网络是额外搞出来的,打不通、管不好,怎么能用来做容器平台?” 这反映出企业对“统一网络平面”的高度需求。如果虚拟机和容器之间的通信无法原生打通,或者网络安全策略不能统一配置,平台就无法支撑真正的混合架构,也难以满足等保、服务暴露、应用互访等核心诉求。 |

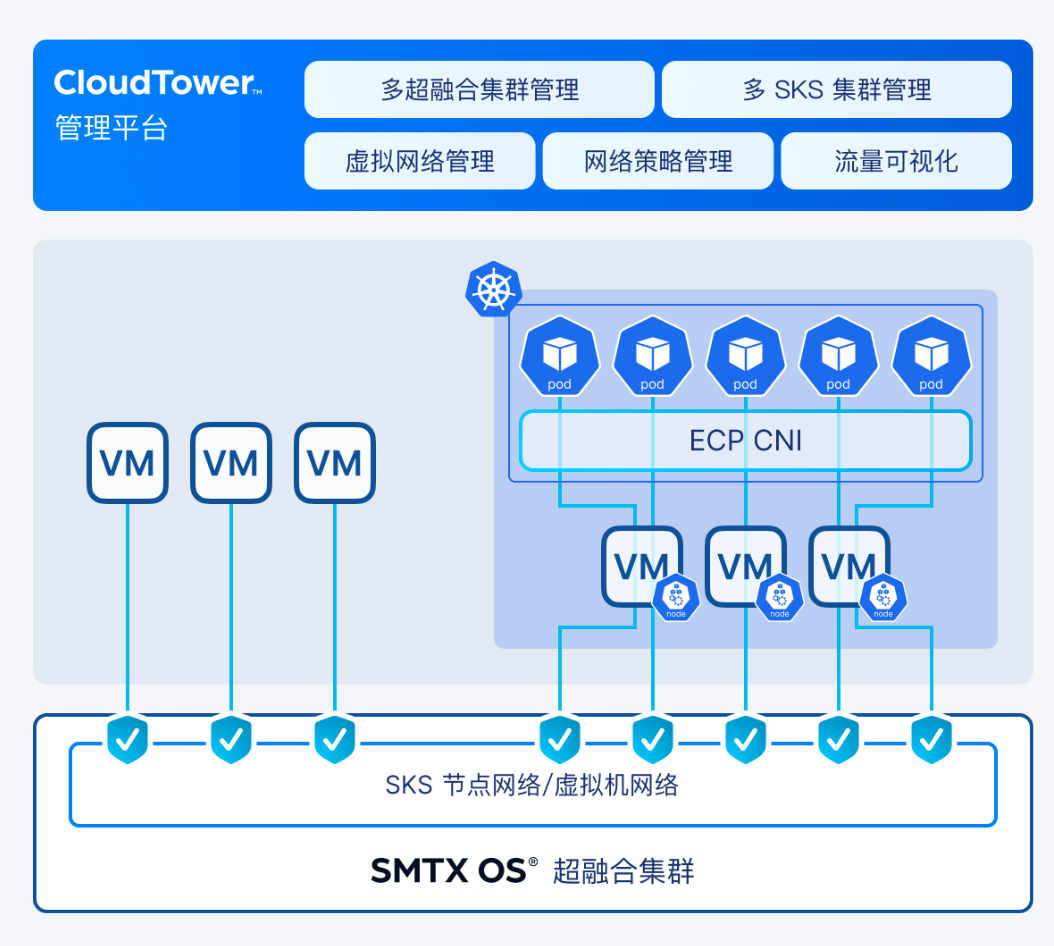

| ✅ 基于 SmartX 企业云的真实情况 |

| SKS 深度集成网路插件 Everoute Integrated CNI(EIC),采用扁平化网络架构,将 Kubernetes Pod 直接连接到超融合集群的虚拟化网络,避免了 Overlay 网络常见的性能损耗问题,提供了接近物理网络的高效通信性能。 利用 EIC,Pod 和虚拟机网络实现了原生互通,无需额外桥接或路由装置,显著降低了网络管理复杂性。Pod 的 IP 地址可静态分配,即使在跨节点调度时也不会改变,有效简化了网络维护和故障排查。 此外,EIC 与 Everoute 安全策略深度融合,使得 Pod 间、Pod 与虚拟机间的网络访问控制变得统一且易于管理,支持企业在统一平台上实现精细化的安全策略,满足严格的安全规范和监管要求。 综合以上能力,SKS 能够在保障网络性能和安全性的同时,降低网络配置与维护的复杂度,成为一种企业部署容器平台的可靠基础架构方案。 |

看法六:VMware CaaS 成熟稳定,难以实现国产化替代

| ❌ 误区成因 |

| 长期以来,VMware 在虚拟化和容器化领域积累了大量成熟的部署和管理经验,其基于 vSphere 和 Tanzu 构建的容器即服务(CaaS)平台被广泛应用于企业级生产环境。但随着近年来国产化和自主可控要求的不断深入,越来越多企业开始意识到: -VMware 平台的许可和订阅模式正在发生重大变化,成本不断攀升; -企业对底层基础架构国产化、自主可控的需求逐步提升; -面对国产化芯片与操作系统环境,VMware 等国外厂商的适配和支持节奏可能无法满足快速迭代的需求。 因此,不少企业产生了这样的担忧:“VMware CaaS 虽然成熟,但国产化替代难度很高;超融合架构能不能在容器管理方面实现 VMware 同等级别的稳定性和性能?” 这些疑虑并非毫无根据。VMware 在容器化和虚拟化的集成管理、生态成熟度、生产经验积累等方面确实走在行业前列。但在当前的行业趋势下,国产化替代已成为企业级容器化平台建设的迫切要求之一。因此,如何在满足国产化自主可控的同时,又能实现 VMware CaaS 平台同等级别的稳定性、功能性和易用性,成为企业在选择替代平台时的重要考量。 |

| ✅ 基于 SmartX 企业云的真实情况 |

| SKS 作为一款构建在自主研发的超融合平台上的容器服务产品,已在多家头部金融、制造和海外客户中落地验证,具备完整的企业级容器平台能力: -SKS 支持虚拟机与物理机混合构建 Kubernetes 集群,结合生产级分布式存储与统一网络安全平台,提供从计算、存储到网络的一体化支撑体系,帮助用户重构基础设施底座。 -SKS 遵循 Kubernetes 开放标准,兼容主流容器生态(如 Rancher、KubeSphere、灵雀云等),不绑定平台组件,支持企业保留原有 DevOps 工具链、监控方案和服务目录,降低切换门槛。 -基于 Cluster API 的自动化能力,SKS 提供了图形化的一键部署、扩缩容、版本升级与故障节点替换等功能,帮助企业快速构建面向生产的集群环境,大幅缩短交付周期,降低运维复杂度。 -SKS 在信创生态下已完成对主流国产芯片、操作系统、数据库的兼容适配,具备良好的落地基础。对于亟需推动信创替代的客户而言,SKS 不仅提供了 Kubernetes 能力,更提供了一个“容器+虚拟化+分布式存储+SDN”的一体化架构,成为企业落地自主可控 CaaS 能力的关键抓手之一。 |

企业实践:SKS 助力某信托公司替代 VMware Tanzu,构建双活容器平台

某信托公司是一家聚焦农业金融和乡村振兴的非银行金融机构,早期通过 VMware vSphere 和 Tanzu Kubernetes Grid 构建容器平台,支撑微服务化应用部署。在新一轮架构升级中,用户面临以下挑战:

- VMware 停止永久许可销售,推动订阅制,导致 IT 成本上升;

- 容器平台国产化替代迫在眉睫,Tanzu 缺乏可持续交付保障;

- 必须满足信创监管要求,实现 IT 基础架构国产化与自主可控;

在数字化转型和合规需求驱动下,用户决定结合已有的 SmartX 企业云基础设施集群,验证并推进虚拟化与容器平台全面替代 VMware 的可行性,同时实现双活部署架构。

替代方案与阶段验证

用户以 SmartX 原生虚拟化 ELF 和 SKS 为基础,替代 VMware vSphere 和 TKG,并通过两阶段验证逐步推进替代进程:

功能验证阶段

- 使用 3 台国产海光服务器部署 ELF 集群,构建标准 Kubernetes 工作负载集群;

- 验证 SKS 支持多集群纳管、自动化部署、节点滚动升级、自愈等核心能力;

- 集群被纳管进 Rancher 平台,兼容原有 DevOps 工具链与镜像仓库,无需改动用户现有运维体系;

双活验证阶段

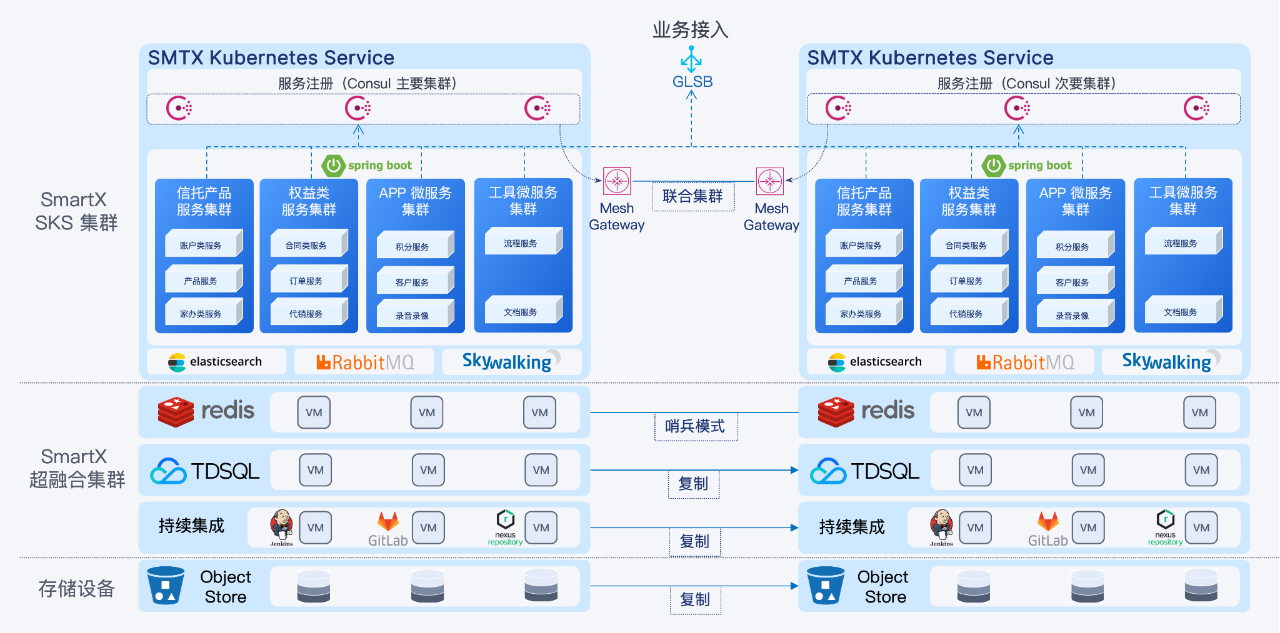

- 搭建两个 4+4 节点企业云基础设施集群,在两个同城数据中心分别部署 SKS 集群;

- 双站点分别部署生产与 UAT 环境,模拟跨中心业务容灾;

- 使用 GSLB 实现接入高可用,微服务层通过双 Consul 集群实现服务自动切换;

- Redis、TDSQL 等数据库以虚拟机方式运行,通过哨兵和复制机制实现高可用;

- Jenkins、GitLab 等 DevOps 工具部署在 VM 上,保障持续集成服务稳定运行;

统一管理与多层高可用

两地 SKS 集群均纳入 CloudTower 平台统一管理,实现跨架构、跨芯片、跨集群资源的可视化调度与运维,提升了整体资源利用效率和运维便捷性。在架构设计上,该公司构建了多层级高可用方案:

- 节点级容错:SKS 自愈机制保障节点故障时自动恢复业务;

- 服务级容错:基于 Consul 的分布式注册中心保障服务间通信不间断;

- 数据中心级容错:通过同城双活架构,保障在任一数据中心故障下业务连续可用;

建设价值与阶段成果

通过本次替代实践,用户实现了:

- 基础架构层从 VMware 向国产平台平滑过渡;

- 容器平台实现国产可控替代,保障长期交付能力;

- 构建基于微服务的高可用容器平台,实现跨数据中心的业务连续性;

此外,用户制定了“超融合架构升级-国产化改造-信创转型”的分阶段演进路径:

- 第一阶段:完成存储国产化和虚拟化平台替代,保留 VMware 使用习惯,降低迁移风险;

- 第二阶段:实现容器平台国产化,构建统一纳管的现代化运维体系;

- 第三阶段(规划中):引入信创架构服务器,构建多芯片异构环境下的全栈信创平台。

欲深入了解,请阅读:某信托公司:替代 VMware 虚拟化与容器平台,构建业务双活超融合集群

总结:超融合,是构建国产化容器平台的可行选择

容器技术的普及正在推动企业 IT 架构加速转型,而平台在可控性、弹性、安全性和运维效率等方面的能力,成为支撑这一转型的关键因素。实践证明,基于超融合架构的榫卯企业云平台,能够通过统一的计算、存储、网络与容器服务,满足企业在性能、交付、运维、安全与生态兼容性等方面的核心诉求,并提供一条可演进、可落地的 VMware 替代与信创适配路径。

超融合不应再被视为容器场景的“次优选择”,而是企业在构建稳定、敏捷、低成本容器平台时的一种合理解法。未来,SmartX 将持续打磨容器与虚拟化融合基础设施产品力,携手更多客户推进技术自主可控进程,为构建新一代企业云平台奠定坚实基础。

欲了解更多榫卯企业云平台超融合架构下的功能特性,欢迎下载《超融合技术原理与特性解析合集》三册电子书。

SmartX 超融合技术原理与特性解析合集(一)虚拟化与存储

更多“超融合常见误区解读”文章:

常见误区解读之一:超融合不是云,是过渡性产品和技术,不能满足建云需求?